Datenjournalismus – Storytelling mit Hilfe von Daten

November 19, 2019

Der Arbeitsalltag eines Journalisten hat sich in den letzten Jahren massiv verändert. Qualitativ hochwertiger Journalismus rutscht immer mehr in eine Nische, oftmals werden News über Social Media Plattformen kostenlos konsumiert. Das Thema Datenjournalismus gewinnt and Wichtigkeit.

Gleich zu Beginn erklärt Barnaby Skinner, was er unter Datenjournalismus versteht – nämlich die Automatisierung des Journalismus.

Heute werfen wir einen Blick darauf, was Technologie für einen Einfluss auf den Journalismus hat und wie sieht ein Arbeitsalltag eines “modernen” Journalisten aussieht.

Barnaby Skinner leitet das Team Datenjournalismus bei Tamedia und hat somit viel praxisbezogene Erfahrung in diesem Bereich. Im heutigen Unterrichtstag werden folgende Bereiche näher angeschaut:

Durch Künstliche Intelligenz hat sich die Newsbranche in den letzten Jahren massiv verändert. News werden oftmals über Social Media Apps bezogen – beispielsweise Facebook, Instagram, Twitter etc. Was haben diese Unternehmen gemeinsam? Hinter all diesen Unternehmen stehen Algorithmen, welche nach Kennzahlen (beispielsweise Klicks) die publizierten Inhalte optimieren. Doch wie genau dieses Ranking zu Stande kommt, ist fragwürdig und ist sowohl für die Öffentlichkeit als auch die Publizierenden nicht nachvollziehbar.

So wird Google News nach Klicks optimiert und Quellen werden nach Autorität eingeteilt (bspw. Verlagshäuser haben ein Rating für ihre Vertrauenswürdigkeit). Das führt unter anderem zu nach User personalisierten Google News Feeds und nicht zu einheitlichen Feeds.

Zudem ergibt diese Automatisierung häufig Fehler, wie das Beispiel von United Airlines zeigt. So hat Google bei diesem Ereignis fälschlicherweise eine alte Information als neu vermeldet. Durch die rasche Weiterverbreitung dieser Schlagzeile fühlte sich der Algorithmus von Google bestätigt, dass diese Meldung von brennendem Interesse für die Allgemeinheit ist und wurde weiter als “Trending” gelistet und so weiter verbreitet- ein Schneeballeffekt sozusagen. Doch diese veraltete Schlagzeile führte zu einem finanziellen Schaden des betroffenen Unternehmens – so halbierte sich der Aktienkurs von United Airlines innerhalb von wenigen Minuten um die Hälfte – aufgrund einer veralteten Meldung! Obwohl Google diese Meldung relativ schnell zurückgezogen hat, hatte sich der Aktienkurs nicht so schnell erholt.

Dieses Beispiel zeigt einerseits, dass Online-Inhalte von den Nutzern zu wenig hinterfragt werden (Ist das überhaupt realistisch und relevant, was hier geschrieben ist?) und dass es keine Kontroll-Instanz bei der Publikation und Weiterverbreitung der Online Inhalte gibt.

Gemäss Barnaby Skinner hat das mit Journalismus nicht viel zu tun. Ein Grossteil der Arbeit eines Journalisten ist es, Quellen zu verifizieren und daraus Inhalte zu publizieren. Doch mittlerweile ist die Medienbranche von “Fake News” gebeutelt – oft sind die meistgeklickten Beiträge nicht aufgrund von journalistischer Arbeit entstanden und genau so oft ist es auch fragwürdig, wie diese Likes entstanden sind. Das stellt traditionelle Medienhäuser vor grosse Herausforderungen – wie balanciert man neutrale Berichterstattungen und generiert trotzdem genügend Traffic und Reichweite um für Werbepartner interessant zu sein?

Bei Tamedia beschäftigt man sich intensiv mit den Fragen, welche Inhalte und Werbung die Nutzer sehen wollen und natürlich das Potenzial zu eruieren, wer dafür bereit wäre zu zahlen. Um diese Fragestellungen zu beantworten, setzt Tamedia Machine Learning ein.

Twitter Account Lesermeinung kompakt

Ein Pilot-Projekt ist beispielsweise der Twitter-Account “TA Lesermeinung” . Mit Hilfe von Algorithmen werden relevante und qualitativ hochwertige User-Kommentare komplett automatisch eruiert. Diese Kommentare sollen zum nachdenken und diskutieren anregen und somit eine “Community” entstehen. Bereits in anderen Unterrichtseinheiten haben wir die Schwierigkeit besprochen, einer Maschine die Bewertung eines geschriebenen Textes beizubringen – wann ist ein Kommentar sexistisch, wann ist er ironisch – welche müssen entfernt werden weil sie nicht relevant sind etc. Dafür sind Unmengen von Trainingsdaten nötig, damit die Maschine aus vergangenen Kommentaren lernen kann und somit neue Kommentare beurteilen kann. Tamedia nutzt diese Algorithmen für ein besseres Verständnis ihrer Community. Doch trotz aller Automatisierung hebt Barnaby Skinner fest, dass es eine menschliche Kontrollinstanz benötigt.

Algorithmic Accountability Reporting umschreibt die Aufgabe des Journalismus, die Nachvollziehbarkeit von datenbasierten Entscheidungen sicherzustellen, sprich also den Bias (verzerrte Wahrnehmung) welche datenbasierte Algorithmen zugrunde liegt zu verstehen. Im Fall von Entscheidungen durch künstliche Intelligenz (beispielsweise welcher Artikel wird wo publiziert, welche Bilder tauchen in meiner Google Suche auf, welcher Straftäter hat ein höheres Rückfallrisiko) ist es wichtig zu verstehen, aufgrund welchen Kriterien der Algorithmus zu einer Aussage gelangt. Weitere Informationen zu diesem sehr spannenden Bereich ist auf der Webseite von Datenjournalist.de ersichtlich.

Algorithmic Accountability ist der nächste logische Schritt in einer Welt des automatisierten Entscheidens. Demokratische Gesellschaften, die vermehrt durch und mit Software regiert werden, müssen in der Lage sein, solche „Maschinen“ zu verstehen und kontrollieren. Es ist die Aufgabe von Journalisten, diesen Fragen nachzugehen und somit Öffentlichkeitsarbeit zu leisten.

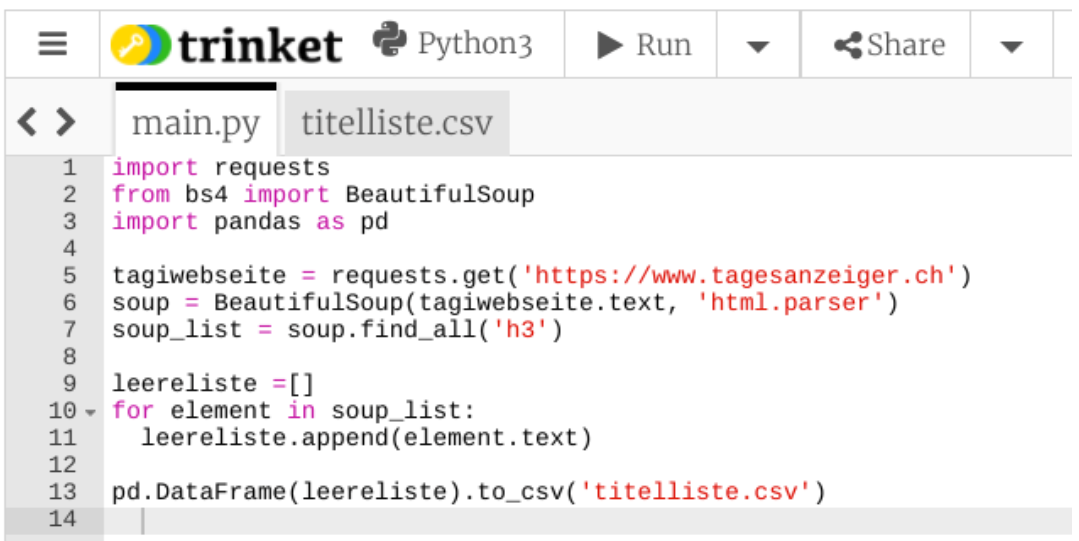

Der Theorieblock zum Thema Datenjournalismus ist nun abgeschlossen. Am Nachmittag gings ans Eingemachte: In einer rund dreistündigen interaktiven Session mussten die Studierenden Python und Google Spreadsheet nutzen um Daten zu manipulieren. Für viele Studierende war dies die erste Berührung mit der Programmiersprache Python – dementsprechend war auch der Stolz gross, als der erste Query erfolgreich verlief.

Python 3 Code

– Propulsion Academy

– Exts EPFL

– CAS MAZ

– The Lede Program

Zum Schluss vom Tag haben wir noch den Case “Swiss Asylum Lottery” besprochen. Dabei ging es um die Durchforstung der Datenbank des Bundesverwaltungsgerichts. Das Tamedia Team rund um Barnaby Skinner analysierte dabei die Urteilssprechungen im Asylwesesn und konnte beweisen, dass die Parteizugehörigkeit des Richters Einfluss auf sein Urteil hat.

Übersicht der Auswertung

Weitere Informationen zu dieser Geschichte findet man hier.

Bleibe auf dem Laufenden über die neuesten Entwicklungen der digitalen Welt und informiere dich über aktuelle Neuigkeiten zu Studiengängen und Projekten.