Ethik und AI: in dubio pro malo

August 3, 2019

Aus dem Unterricht des CAS AI Management mit Dorothea Baur berichtet Corinne Fleury über Ethik und Künstliche Intelligenz:

“Was ist Ethik?” fragt uns Dorothea Baur, Expertin im Bereich Verantwortung, Nachhaltigkeit und Ethik, im heutigen Unterricht des CAS AI Management. Sie erklärt uns dazu:

Ethik ist eine Unterdisziplin der Philosophie – Philosophie ist die Liebe zur Weisheit.

Die Grundlage der Ethik beschäftigt sich mit der Frage – «was SOLLEN wir tun?» und versucht philosophisch zu reflektieren, wie wir unsere Regeln begründen können. Wie sollen wir unser gerechtes Zusammenleben gestalten und was ist ein gutes Leben? Welche Normen sollen mich führen, was ist der höchste Wert, der uns leiten soll? Diese Werte müssen wir uns selber definieren. Wir tragen Verantwortung für alles, was durch unser menschliches Handeln, sowohl heute und wie auch in Zukunft, verändert und nicht den Naturgesetzen unterstellt werden kann.

Für frühere Philosophen wie Aristoteles und Kant war Ethik eine philosophische Disziplin, die den gesamten Bereich des menschlichen Handelns zum Gegenstand machte. Jedoch entwickelt(e) sich die Ethik im Verlauf der Zeit immer weiter. Vom ursprünglichen Verhältnis «Mensch – Mensch» – bis zukünftig «Mensch – Maschine». Mit voranschreitendem Fortschritt im Bereich der Künstlichen Intelligenz, dem maschinellen Lernen und damit den selbstlernenden Algorithmen erreicht die Ethik eine neue Dimension. Dabei muss sich Ethik nicht nur mit unserem heutigen Verhalten beschäftigen, sondern vielmehr auch mit unserem Einfluss auf die Zukunft.

Dazu schrieb Hans Jonas in den siebziger Jahren das Buch «Das Prinzip der Verantwortung» worin er eine Ethik für die technologische Zivilisation entwickelt. Darin schlägt er die Entscheidungsregel «In dubio pro malo» (gib der schlechteren Prognose den Vorrang) für den Umgang mit den verbleibenden Ungewissheiten vor. Diese beruht auf dem Entscheidungsprinzip, bei Zweifel die schlechtere Prognose vorzuziehen (ist zum Beispiel eine Technologie wünschenswert und moralisch legitim?).

Handle so, dass die Wirkungen deiner Handlung verträglich sind mit der Permanenz echten menschlichen Lebens auf Erden» (Prinzip der Verantwortung, Hans Jonas).

Daraus leiten sich folgende Fragen zu Ethik und AI ab:

Ethik ist kein Attribut, welches richtig oder falsch definiert. Die Beantwortung ethischer Fragen verlangt daher nach Reflexion und Nachdenken. Daher gibt es verschiedene Massnahmen, um Ethik zu berücksichtigen. Diese ethischen Ankerpunkte zu AI lassen sich auf vier Ebenen finden:

Neben ethischen Prinzipien, welche Handlungsgrundsätze innerhalb eines Unternehmens beschreiben können, sind auch Ethik Kommissionen ein beliebtes Instrument, um Ethik im Unternehmen zu verankern.

So hat zum Beispiel Microsoft sechs Grundsätze für AI und Ethik aufgestellt:

Microsoft: Ethik- Prinzip Nr. 6

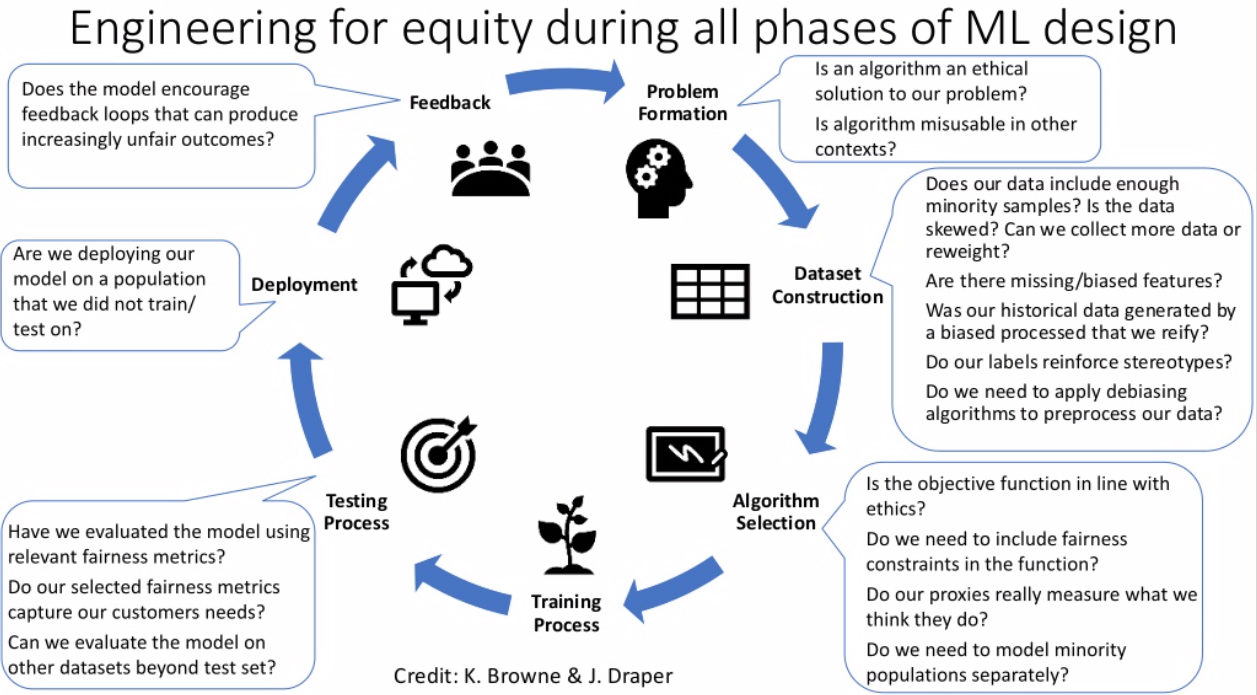

Beim Training eines Machine learning (ML) Modells ist es wichtig darauf zu achten, dass in allen Prozessschritten (Vor- und Nachphase) Wert auf die Einbindung ethischer Fragen gelegt wird. Dies beginnt bereits bei der Problemformulierung. Die Prozessschritte können als ML- Kreislauf dargestellt werden:

Gerechtes Entwickeln während allen ML- Phasen

Nur so können sogenannte ethische Blind Spots erkannt werden, was aber sind Blind Spots? Darunter verstehen wir ein Versehen im Arbeitsablauf eines Teams, welches schädliche unbeabsichtigte Folgen haben kann. Sie können auf unbewusste Vorurteile oder strukturelle Ungleichheiten in der Gesellschaft zurückzuführen sein. Die Konsequenzen von Blind Spots sind schwer vorherzusehen. Sie haben jedoch tendenziell negative Auswirkungen auf historisch marginalisierte Gemeinschaften.

Ethische Fragen müssen in den drei AI- Projekt Phasen – Planning, Building, Deploying – Berücksichtigung finden:

Algorithmische Entscheidungssysteme können beispielsweise unbeabsichtigt zu Diskriminierung (Bias) führen, wenn die zugrunde liegende Datenbasis unvollständig oder falsch ist. Diese kann eine Diskriminierung von bestimmten Personengruppen oder Minderheiten sein. AI- Systeme aus den USA sind in Kritik geraten, weil diese die Rückfall Wahrscheinlichkeit von Straftätern und die damit verbundene Haftdauer beeinflussten. Ein anderes Beispiel ist die Benachteiligung von Bewerberinnen im Rahmen eines maschinellen Auswahlverfahrens.

Wie unterscheidet sich Bias von Diskriminierung?

Bias ist ein technisches Konzept, das sich zum Beispiel auf Selektion, Sampling oder Reporting bezieht. Dagegen betrifft Diskriminierung Eigenschaften, die als Basis für ungerechtfertigte und systematische Ungleichbehandlung in der Vergangenheit dienten. Sie sind aber immer abhängig vom Anwendungsfall. Es wäre jedoch trügerisch zu glauben, dass bei Menschen weniger diskriminierende Entscheidungen fallen als bei Maschinen.

Was verstehen wir unter Fairness? Das Wort «fair» drückt eine (nicht gesetzlich geregelte) Vorstellung von Gerechtigkeit aus.

Fairness

Unseren Unterricht runden wir ab mit drei Fallbeispielen aus den Bereichen:

Wer sich in diese Themen vertiefen möchte, findet unter diesem Link die entsprechenden Fallstudien.

Grundsätzlich macht der Einsatz von Künstlicher Intelligenz da Sinn, wo Menschen an ihre Grenzen stossen. Wir Menschen müssen aber dabei sicherstellen, dass Künstliche Intelligenz in Zukunft nicht die menschlichen Fehler der Vergangenheit wiederholt. Dazu verankern wir Immanuel Kants Denkanstoss in unseren Gehirnen:

Habe Mut Dich Deines eigenen Verstandes zu bedienen…

Bleibe auf dem Laufenden über die neuesten Entwicklungen der digitalen Welt und informiere dich über aktuelle Neuigkeiten zu Studiengängen und Projekten.