Was ist Artificial Intelligence (AI)?

August 24, 2020

In der heutigen Vormittagssession nimmt uns Afke Schouten, AI Management Consultant und Data Scientist, mit auf eine Reise durch die Welt der künstlichen Intelligenz (KI) oder Englisch: Artificial Intelligence (AI). Afke stellt uns die kritische Frage: “Ist “Artificial Intelligence” nur ein weiteres Buzzword?” Diese Fragen werden wir vielleicht später beantworten können. Zunächst geht es allerdings an die Grundlagen: Was ist AI überhaupt und was ist es nicht?

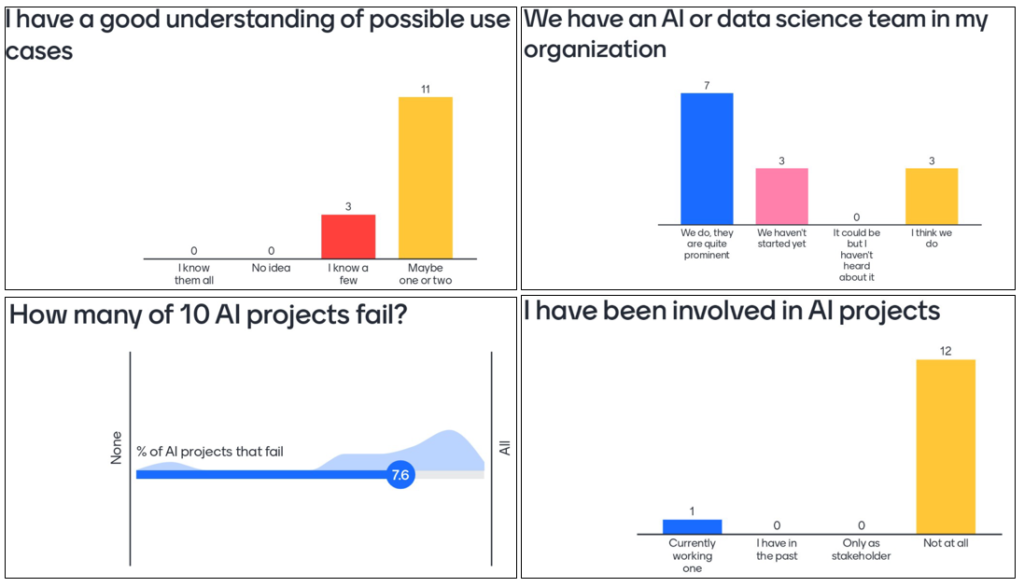

Eine kurze Umfrage auf Mentimeter zeigt, dass AI bei den Versicherungen zwar angekommen ist und dort schon einiges ausprobiert wird jedoch noch nicht viele Projekte wirklich zum Fliegen gekommen sind. Afke bestätigt:

85% der AI Projekte werden nicht realisiert

Die Ergebnisse aus dem Mentimeter im Überblick:

Zum Aufwärmen probieren wir in Gruppen AI in einem Satz zu beschreiben. Auch wenn die Definitionsversuche der Studierenden inhaltlich sehr nahe beieinander liegen, merkt man schnell: Es ist nicht ganz so einfach, eine solch kompakte und klare Beschreibung von AI in einen Satz zu fassen. Afke definiert AI wie folgt:

“Daten nutzen um Entscheidungen zu automatisieren, die vorher von Menschen gemacht worden sind”

Dabei ist ganz wichtig, dass zuerst geklärt wird, worüber man spricht! Denn es gibt verschiedene Definitionen von AI. Je nach dem kann auch ein Regelwerk (Bsp. Im Outlook Postfach) bereits als AI bezeichnet werden.

Der Begriff AI ist insofern nicht eindeutig abgrenzbar, als es bereits an einer genauen Definition von „Intelligenz“ mangelt. Dennoch wird er in Forschung und Entwicklung verwendet.

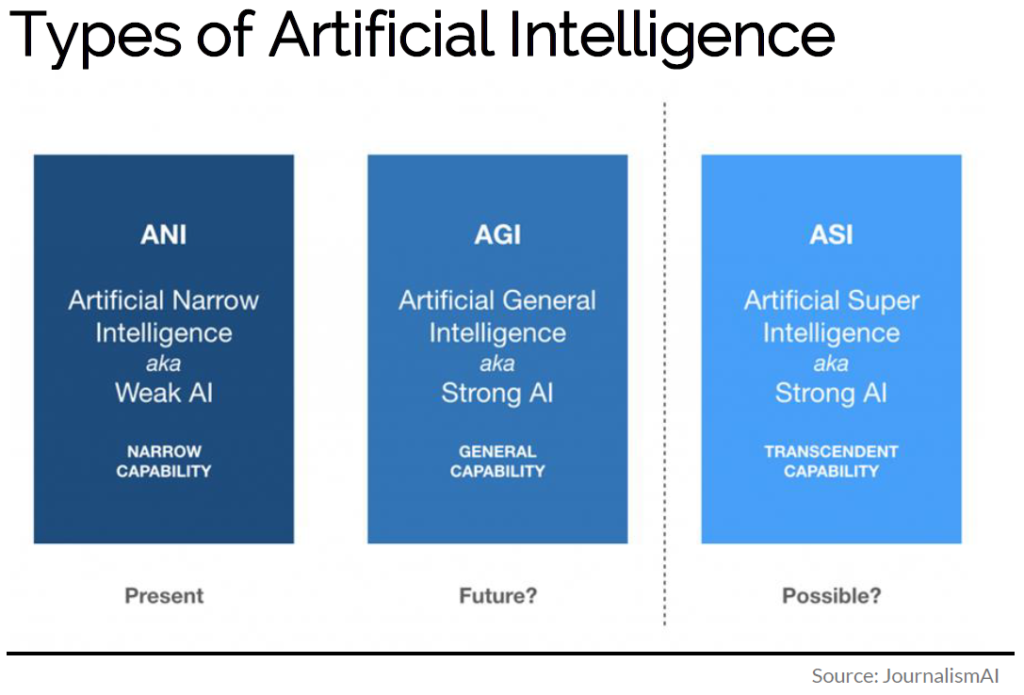

Es wird zwischen drei Typen von AI unterschieden:

Die Anwendungen welche heute bestehen und verwendet werden, gehören zum Typ Artificial Narrow Intelligence (ANI). Dabei versteht man die automatische Ausführung von einer einzigen Aufgabe durch die Maschine. Beispiele davon sind Regelwerke im Outlook, Chatbots oder die Siri Spracherkennung im iPhone.

Unter General Artificial Intelligence (AGI) versteht man ein System, welches Menschliche Intelligenz simuliert. Das heisst Computersysteme müssten wie wir Menschen lernen, aus Erfahrungen neue Erkenntnisse zu entwickeln, um diese selbstständig bei neuen Problemstellungen anzuwenden. Bisher wurden noch keine solche Systeme entwickelt.

“Die Artificial super Intelligence (ASI) ist die künstliche Intelligenz, die einmal die Weltherrschaft übernehmen wird”, sagt Afke und lacht. ASI Systeme wären fähig, ein eigenes Bewusstsein zu entwickeln und könnten dadurch die menschliche Intelligenz übertreffen. Aus heutiger Sicht liegt ASI noch in ferner Zukunft.

Die Anfänge von AI beginnen bereits in 1956: Am Dartmouth College wurden Ansätze von AI entwickelt. Lange Zeit reichte die Rechenleistung jedoch nicht aus, um die Datenmenge verarbeiten zu können. In 2011 gelang AI mit Siri von Apple oder IBM mit der Watson Q&A Maschine der Durchbruch.

Die meisten Beispiele von AI, die wir heute kennen, stammen aus Startups oder Big Techs. Die bestehenden Unternehmen scheinen noch nicht bereit für AI zu sein und die Implementierung bleibt eine Herausforderung.

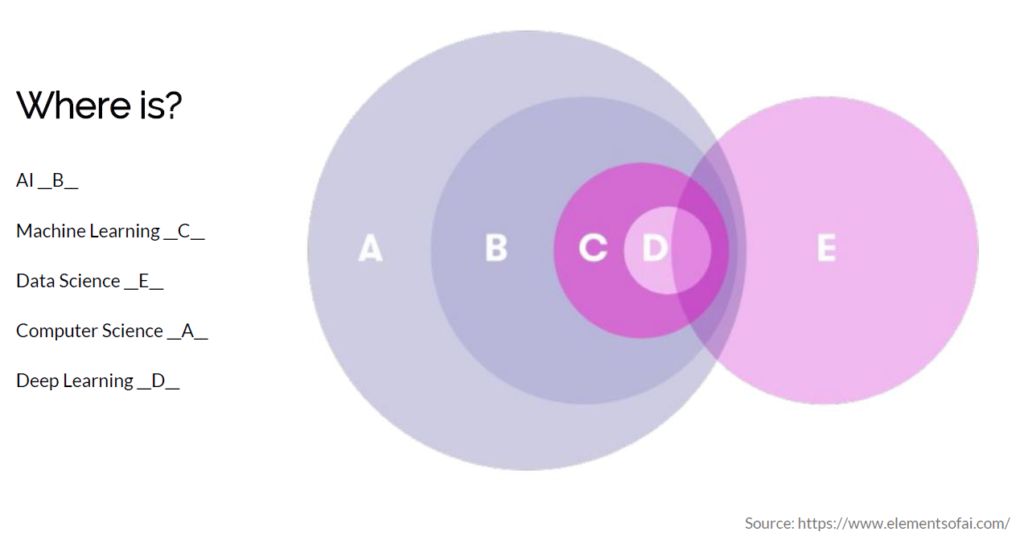

Wichtig ist; Die Bearbeitung von Daten muss nicht nur in Systemen passieren. Die klassische Datenanalyse oder Reportings bestehen auch weiterhin und werden ebenfalls unter dem Begriff Data Science zusammengefasst.

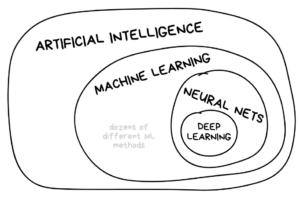

Wenn heute in den Unternehmen von AI gesprochen wird, ist typischerweise Machine Learning oder Deep Learning gemeint. Deep Learning (mehrschichtiges Lernen) bezeichnet eine Methode des maschinellen Lernens, die künstliche neuronale Netze verwendet.

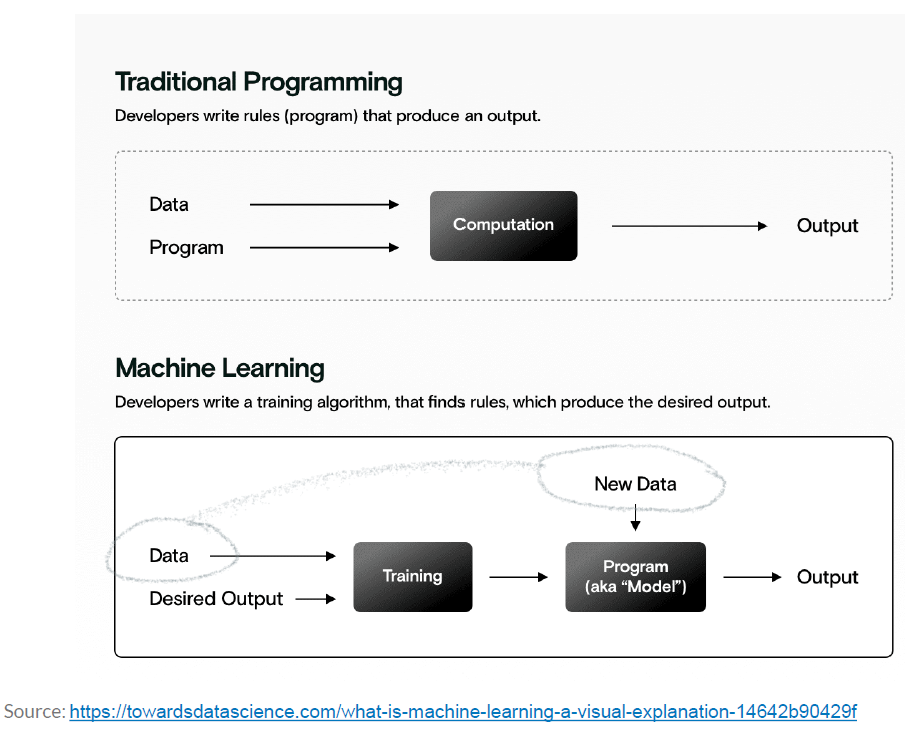

Die Maschine erkennt eine Struktur wie beispielsweise die aus einer Zahlenreihe oder einem Verhaltensmuster, und wendet die erlernte Struktur bei einem neuen Fall an. Die Grundlage damit die Maschine die Struktur erkennen kann, ist ein Modell: Eine vereinfachte Form der Realität oder eine Struktur des gewünschten Ergebnisses (Desired Outcome).

Zudem benötigt es einen Algorithmus (Verfahren zur schrittweisen Umformung von Zeichenreihen; Rechenvorgang nach einem bestimmten Schema) damit die Maschine das Modell lernen kann. Es braucht also das Modell, um die erkannte Struktur auf ein neues Problem anzuwenden. Das menschliche Gehirn macht diese Abfolge automatisch. Da ANI nur eine Aufgabe auf einmal bewältigen kann, benötigt es diesen Zwischenschritt. Beispiele eines Verhaltensmusters:

Die Input-Daten bestehen dabei immer nur aus 0 oder 1. Das bedeutet, dass die Daten aus den Unternehmen umgestellt werden müssen. Bei Farben verhält es sich genau gleich. Jede Zahl entspricht einer bestimmten Graustufe. Ein Abgleich von Gesichtern funktioniert durch diese Funktion. Andere Bilder, wie beispielsweise eines von Rührei mit Speck, müssen benannt werden, damit die Maschine weitere Bilder zuordnen und erkennen kann. Dieser Vorgang wird Labelling genannt. Das zu erkennende Bild (Desired Output) muss der Maschine mitgeteilt werden. Es ist zudem wichtig, dass die richtigen Input-Daten geliefert werden und dass genügend Faktoren berücksichtigt werden, damit das gewünschte Ergebnis erzielt werden kann. Der Data Scientist überprüft die Output Daten und adjustiert den Algorithmus bis das Modell passt und die Ergebnisse der Maschine plausibel sind.

Es gibt viele verschiedene Arten von Machine Learning Typen. Wir lernen zwei davon kennen:

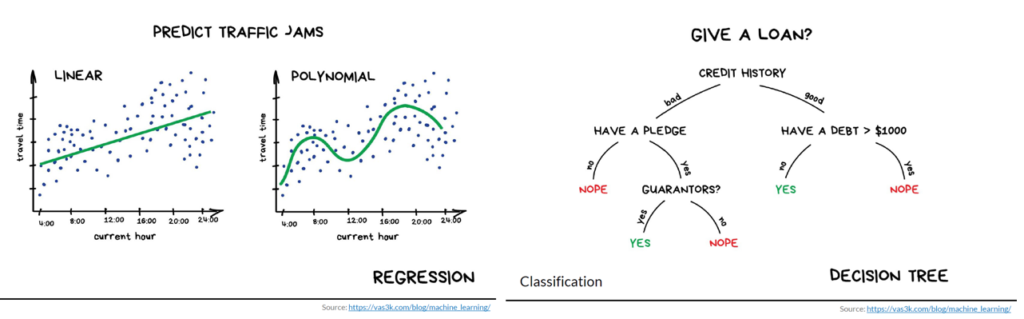

Beim Supervised Learning ist das Ziel, dass die Maschine einen bestimmten Wert bestimmt. Dabei wird unterschieden zwischen Classification: Erkennt eine bestimmte Kategorie, und Regression: Bestimmt einen Wert. Beispiel von Supervised Learning (Regression): Die Daten enthalten Uhrzeit und Zeitdauer von einem Arbeitsweg im Strassenverkehr. Die Maschine gibt dann die Wahrscheinlichkeit eines Verkehrsstaus in einer linearen Form wieder. Ein weiteres Beispiel von Supervised Learning (Classification) ist der klassische Entscheidungsbaum.

Unsupervised Learning ermöglicht dem Modell selbständig Muster und Informationen zu entdecken, die vorher unentdeckt waren. Beispiel: Für drei Kebab Läden in der Stadt wird untersucht, wie viel Zeit die Besucher benötigen, die Standorte aufzusuchen. Zusammen mit der Anzahl der Besuche erkennt die Maschine ein Muster und findet die optimalen Standorte für die Kebab Läden heraus.

Auch das Neuronale Netzwerk ist ein Beispiel von Unsupervised Learning. Das Neuronale Netz verändert sich entsprechend den verschiedenen gesetzten Parametern (Eingabemustern) von selbst. Deep Learning ist eine moderne Methode zum Aufbau, zur Ausbildung und zur Nutzung neuronaler Netze.

Quelle: vas3k

Wichtig: bei der Wahl des richtigen Machine Learnings Typs, ist zuerst zu überlegen, welches Problem wir angehen wollen und danach den passenden Typen ausfindig zu machen. Es wäre falsch zu sagen “Deep Learning ist cool, was machen wir nun damit”. Der Ansatz Machine Learning zu verwenden soll immer getrieben sein von einem bestimmten Business Case. Das Modell oder der Algorithmus werden dann auf Basis der vorhandenen Daten und dem Maschine Learning Typs gewählt.

Ist AI also nur ein Buzzword?

Ja und nein. Gemäss Afke sind wir an der technischen Basis angelangt, aber die meisten Unternehmen sind noch nicht bereit und es wird noch nicht viel gemacht, obschon, wie wir durch die Grundlagen nun gelernt haben, viel gemacht werden könnte!

Die Dos und Dont’s bei AI in der Versicherung

Künstliche Intelligenz: Business Value oder Buzzword?

Bleibe auf dem Laufenden über die neuesten Entwicklungen der digitalen Welt und informiere dich über aktuelle Neuigkeiten zu Studiengängen und Projekten.